A sabedoria convencional diz: «Se não quer que os seus dados sejam utilizados, retire-se de tudo».

Nós dizemos: «Se os seus dados são recolhidos de qualquer forma, é mais racional influenciar a forma como são utilizados».

Não é: «As empresas devem ter os meus dados?» (Elas já os têm).

A verdadeira questão é: «Os meus dados devem contribuir para construir uma IA melhor para todos?»

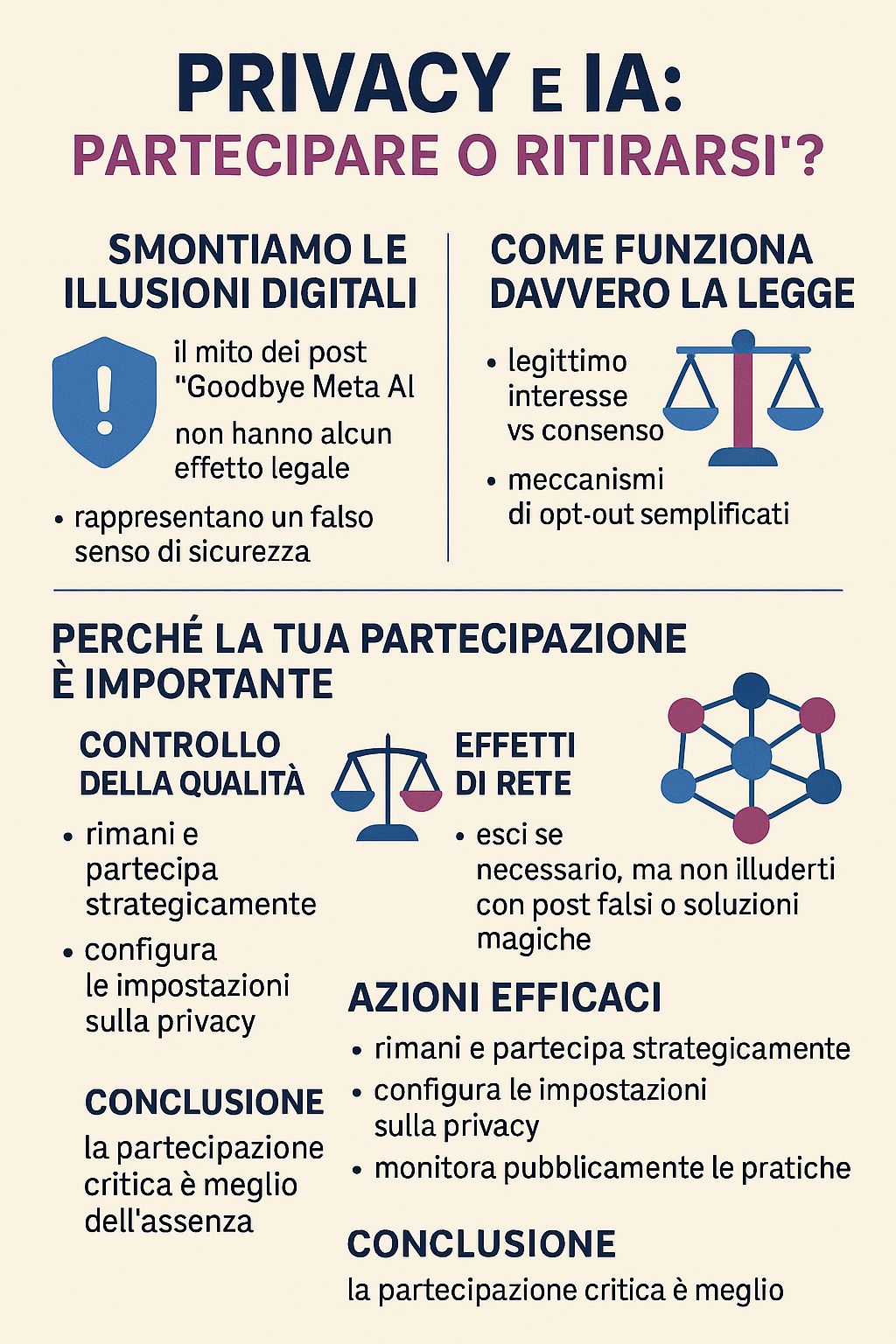

Antes de construir um argumento sério, é fundamental desmontar uma ilusão perigosa que circula nas redes sociais: as publicações virais «Goodbye Meta AI» que prometem proteger os seus dados simplesmente partilhando uma mensagem.

A verdade incómoda: estas publicações são completamente falsas e podem torná-lo mais vulnerável.

Conforme explicado pela própria Meta, «partilhar a mensagem «Goodbye Meta AI» não constitui uma forma válida de oposição». Estas publicações:

O sucesso viral destas publicações revela um problema mais profundo: preferimos soluções simples e ilusórias a decisões complexas e informadas. Partilhar uma publicação faz-nos sentir ativos sem exigir o esforço de compreender realmente como funcionam os nossos direitos digitais.

Mas a privacidade não se defende com memes. Defende-se com conhecimento e ação consciente.

A partir de 31 de maio de 2025, a Meta implementou um novo regime para o treino de IA usando como base jurídica o «interesse legítimo» em vez do consentimento. Isto não é uma lacuna, mas um instrumento jurídico previsto pelo RGPD.

O interesse legítimo permite que as empresas tratem dados sem consentimento explícito, desde que possam demonstrar que o seu interesse não prevalece sobre os direitos do utilizador. Isto cria uma zona cinzenta onde as empresas «adaptam a lei à sua medida» através de avaliações internas.

A utilização de dados não anonimizados acarreta «riscos elevados de inversão do modelo, fugas de memorização e vulnerabilidades de extração». O poder computacional necessário significa que apenas os intervenientes com capacidade muito elevada podem explorar eficazmente esses dados, criando assimetrias sistémicas entre os cidadãos e as grandes empresas.

Agora que esclarecemos a realidade jurídica e técnica, vamos construir o argumento para a participação estratégica.

Quando as pessoas conscientes desistem, a IA treina com quem fica. Quer que os sistemas de IA se baseiem principalmente nos dados de pessoas que:

Os preconceitos na IA ocorrem quando os dados de treino não são representativos. A sua participação contribui para garantir:

Os sistemas de IA melhoram com a escala e a diversidade:

Se utilizar funcionalidades baseadas em IA (pesquisa, tradução, recomendações, ferramentas de acessibilidade), a sua participação contribui para melhorá-las para todos, incluindo futuros utilizadores que mais precisam delas.

A sua privacidade não muda significativamente entre optar por participar e optar por não participar da IA. Os mesmos dados já alimentam:

A diferença é se esses dados também contribuem para melhorar a IA para todos ou servem apenas aos interesses comerciais imediatos da plataforma.

É exatamente por isso que pessoas responsáveis como você devem participar. Retirar-se não impede o desenvolvimento da IA, apenas remove a sua voz desse processo.

Os sistemas de IA serão desenvolvidos de qualquer maneira. A questão é: com ou sem a contribuição de pessoas que refletem criticamente sobre esses temas?

Compreensível. Mas considere isto: preferiria que os sistemas de IA fossem construídos com ou sem a contribuição de pessoas que partilham o seu ceticismo em relação às grandes corporações?

A sua desconfiança é precisamente a razão pela qual a sua participação crítica é tão valiosa.

A inteligência artificial está a tornar-se realidade, quer participe ou não.

A sua escolha não é se a IA será construída, mas se a IA que será construída refletirá os valores e as perspetivas das pessoas que refletem cuidadosamente sobre estas questões.

Optar por não participar é como não votar. Não impede as eleições, significa apenas que o resultado não terá em conta a sua contribuição.

Num mundo onde apenas atores com elevada capacidade computacional podem interpretar e explorar eficazmente esses dados, a sua voz crítica na formação pode ter mais impacto do que a sua ausência.

Permaneça e participe estrategicamente se:

E, entretanto:

Mas não se iluda com:

A sua renúncia individual tem um impacto mínimo na sua privacidade, mas permanecer tem um impacto real em todos.

Num mundo em que os sistemas de IA determinarão o fluxo de informações, as decisões e as interações entre as pessoas e a tecnologia, a questão não é se esses sistemas devem existir, mas se devem incluir o ponto de vista de pessoas reflexivas e críticas como você.

Às vezes, a ação mais radical não é desistir. Muitas vezes, a maneira mais radical é permanecer e garantir que a sua voz seja ouvida.

Anónimo

Não se trata de confiar cegamente nas empresas ou ignorar as preocupações relacionadas com a privacidade. Trata-se de reconhecer que a privacidade não se defende com memes, mas com uma participação estratégica e consciente.

Num ecossistema onde as assimetrias de poder são enormes, a sua voz crítica no treino da IA pode ter mais impacto do que a sua ausência protestatária.

Seja qual for a sua escolha, escolha com consciência, não com ilusões digitais.

Um parágrafo de simpatia também para os «eremitas da privacidade» — aquelas almas puras que acreditam poder escapar completamente do rastreamento digital vivendo offline como monges tibetanos de 2025.

Spoiler: mesmo que vá morar numa cabana isolada nas Dolomitas, os seus dados já estão em toda parte. O seu médico de família usa sistemas digitais. O banco onde guarda as suas economias para comprar lenha rastreia todas as transações. O supermercado da cidade tem câmaras e sistemas de pagamento eletrónico. Até mesmo o carteiro que lhe entrega as contas contribui para conjuntos de dados logísticos que alimentam algoritmos de otimização.

O isolamento digital total em 2025 significa essencialmente excluir-se da sociedade civil. Pode desistir do Instagram, mas não pode desistir do sistema de saúde, bancário, educativo ou laboral sem consequências dramáticas na qualidade de vida.

E enquanto constrói a sua cabana anti-5G, os seus dados continuam a existir nas bases de dados de hospitais, bancos, seguradoras, municípios, agências fiscais e continuam a ser utilizados para treinar sistemas que influenciarão as gerações futuras.

O paradoxo do eremita: o seu isolamento protestatário não impede que os sistemas de IA sejam treinados com os dados das pessoas menos conscientes, mas exclui-o da possibilidade de influenciar o seu desenvolvimento em direções mais éticas.

Em essência, conquistaste a pureza moral imaculada de quem observa a história das arquibancadas, enquanto outros — menos esclarecidos, mas mais presentes — escrevem as regras do jogo.

Seja qual for a sua escolha, escolha com consciência, não com ilusões digitais.

Artigos citados:

Informações adicionais sobre o RGPD e o interesse legítimo:

Recursos oficiais:

Para ações concretas: se estiver na Europa, verifique os procedimentos oficiais de exclusão junto à Autoridade de Proteção de Dados. Para informações gerais, consulte as configurações de privacidade e os termos de serviço da sua plataforma. E lembre-se: nenhuma publicação nas redes sociais tem valor legal.